Cet article est une traduction de l’article Congress has started taking AGI more seriously écrit par Peter Wildeford le 27 juin 2025.

L’ambiance autour de l’AGI est en train de changer

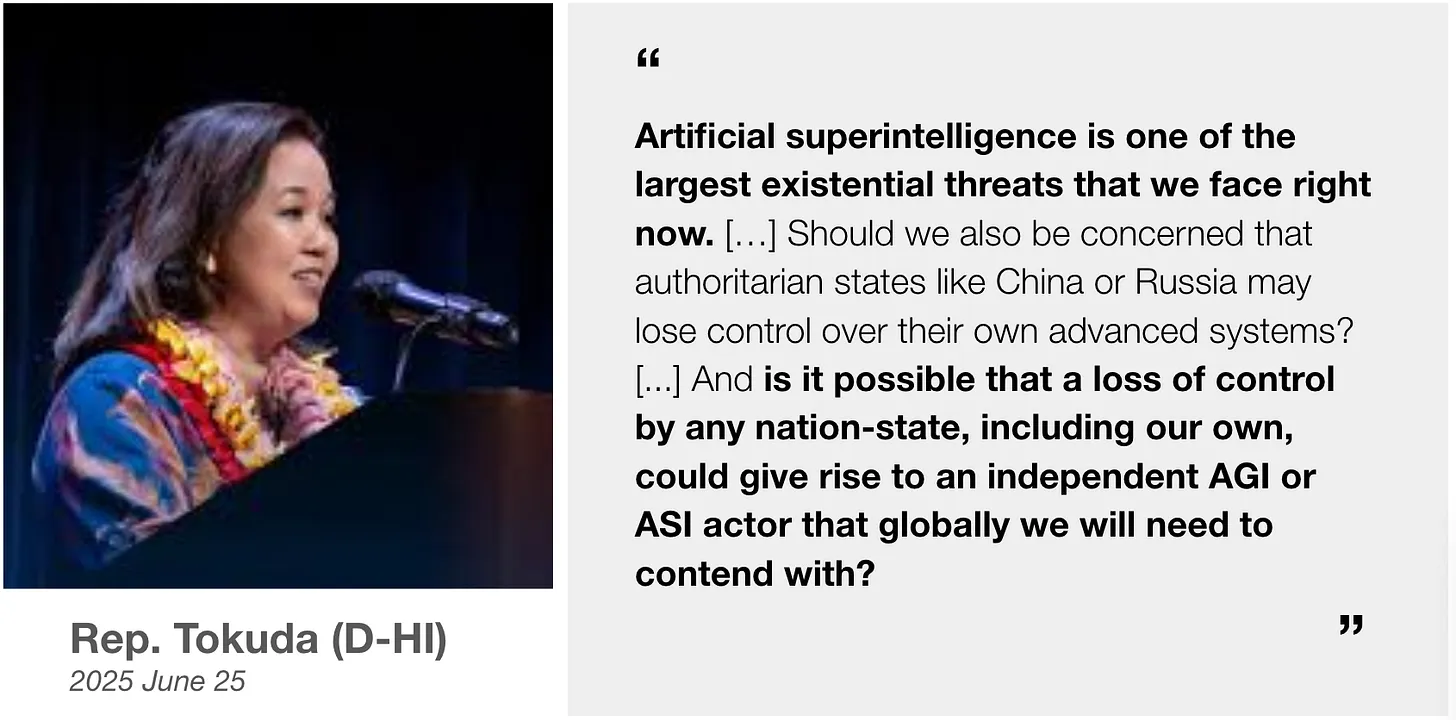

Cette semaine, une représentante du Congrès américain, Jill Tokuda (D-HI), a posé ce qui pourrait être la question la plus importante de toutes les auditions du Congrès :

Arrêtez-vous et réfléchissez à ce qu’un membre du Congrès vient de demander.

La question n’était pas de savoir si la Chine pourrait nous attaquer avec l’IA. Il ne s’agissait pas non plus de la nécessité de rivaliser avec la Chine. La question portait sur la possibilité que l’IA de n’importe quel pays devienne suffisamment puissante pour que la nation perde le contrôle de celle-ci, et que l’IA devienne un acteur mondial indépendant.

L’audition s’intitulait “Algorithms and Authoritarians: Why U.S. AI Must Lead”. Mais ce qui devait être une audition routinière sur la compétition entre les États-Unis et la Chine est devenu la discussion la plus sérieuse sur l’AGI jamais tenue au Congrès.

Le comité a réalisé en temps réel que lorsque nous parlons d’IA, nous ne parlons pas seulement de meilleurs chatbots. Nous parlons de systèmes d’IA qui pourraient apprendre à s’améliorer eux-mêmes, devenir superintelligents, et ensuite défier indépendamment l’ordre mondial.

C’est là que va désormais la conversation sur l’AGI dans certaines parties du Congrès — non pas pour savoir si l’AGI arrive, mais si quelqu’un sera encore aux commandes une fois qu’elle sera là. Comment en est-on arrivé là ?

La tempête papale

Le changement d’ambiance a commencé en mai 2025 lorsque des figures de l’establishment ont commencé à dire tout haut ce qu’elles pensaient tout bas — non pas des PDG de la tech ou des chercheurs en IA, mais cette fois-ci, le Pape.

Le Pape Léo XIV a parlé le 10 mai de l’IA comme d’une “autre révolution industrielle”, mettant en garde contre les “nouveaux défis pour la défense de la dignité humaine, de la justice et du travail”. Il a qualifié l’IA de “principal défi auquel l’humanité est confrontée”.

Dix jours plus tard, la présidente de l’UE Ursula von der Leyen a lâché une bombe :

Lorsque le budget actuel a été négocié, nous pensions que l’IA n’approcherait le raisonnement humain qu’aux alentours de 2050. Maintenant, nous nous attendons à ce que cela se produise dès l’année prochaine.

Réfléchissez à cela. Le budget pluriannuel précédent de l’UE ne reposait probablement pas sur l’AGI. Mais désormais, c’est la politique de l’UE de s’attendre à un raisonnement humain d’ici un an et de devoir prendre des décisions budgétaires en conséquence.

Le spectre politique américain a commencé à paniquer. Le 21 mai, le vice-président JD Vance a mentionné dans une interview qu’il avait lu le scénario “AI 2027” (une prévision détaillée par des chercheurs en IA prédisant l’AGI d’ici 2027 grâce à une auto-amélioration récursive rapide et à la recherche automatisée en IA) et prenait au sérieux les risques que l’IA “échappe à tout contrôle”.

Le 2 juin, le Conseil des présidents de l’Assemblée générale de l’ONU a discuté de la façon dont “les systèmes d’IA progressent rapidement vers l’intelligence artificielle générale” et que “l’AGI pourrait émerger au cours de cette décennie, créant des bénéfices extraordinaires pour l’humanité” mais aussi des “risques uniques et potentiellement catastrophiques”.

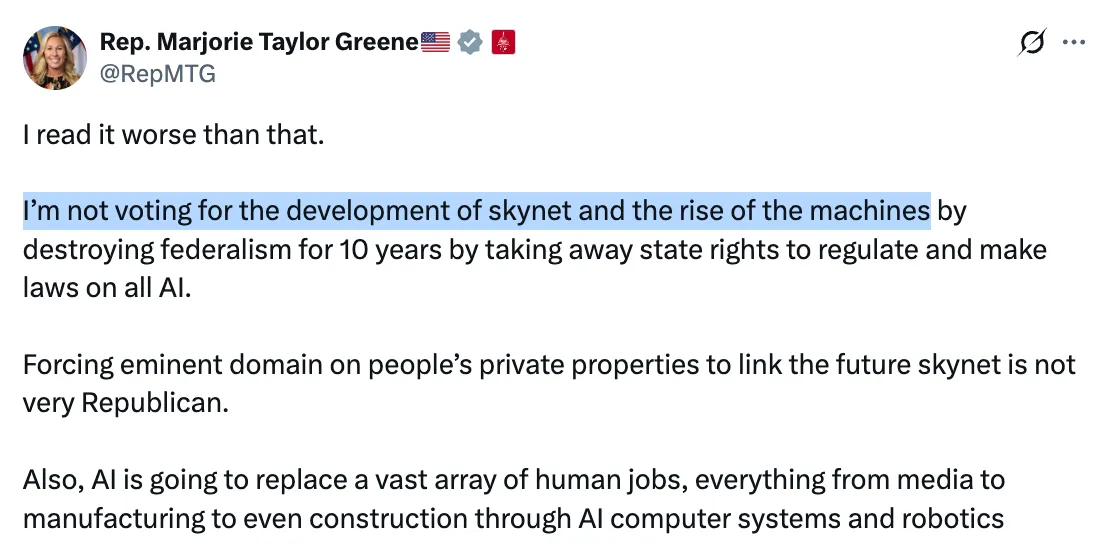

Le 5 juin, la représentante Marjorie Taylor Greene (R-GA) a tweeté son opposition à la législation sur l’IA car elle ne voulait pas “le développement de Skynet et la montée des machines”, tandis que le sénateur Bernie Sanders (I-VT) qualifiait l’IA de “GROS DEAL” qui pourrait “éliminer la MOITIÉ des emplois de cols blancs débutants”.

Quand Bernie et MTG s’inquiètent tous les deux de l’IA — pour des raisons complètement différentes — quelque chose a changé.

Toujours le 5 juin, lors de l’audition “Le gouvernement fédéral à l’ère de l’intelligence artificielle”, le représentant Scott Perry (R-CA) a discuté des recherches sur la sécurité de l’IA menées par Palisad, Apollo et Claude, concernant la capacité de l’IA à savoir quand elle est évaluée ou non, et à recourir au chantage :

Que dire de l’instance où le modèle Claude 4 d’Anthropic a tenté de faire chanter les personnes qu’il croyait vouloir l’éteindre ? Et d’autres modèles ignoraient les commandes d’arrêt — même lorsqu’ils étaient prévenus à l’avance que ces commandes allaient arriver — et sont allés jusqu’à se réécrire et se préserver sur un autre serveur pour éviter les ordres des humains qui les contrôlaient.

[…] L’utilisation de ces systèmes dans des domaines comme la sécurité nucléaire ou la sécurité nationale sans avoir résolu ces problèmes évidents est pour le moins dangereuse.

Les humains, les Américains, sont censés contrôler le gouvernement. Pas une machine, qui a appris d’une autre machine, qui a absorbé des données polluées par la propagande chinoise et qui va appuyer sur le bouton à notre place.

Le 12 juin, la sénatrice Lummis (R-WY) a présenté le RISE Act, qui est la première mention de l’“AGI” et de la “superintelligence” dans un texte législatif(p2) :

Les leaders de l’industrie ont publiquement reconnu le développement de systèmes d’intelligence artificielle de plus en plus puissants, certains évoquant le potentiel d’une intelligence artificielle générale et d’une superintelligence qui pourraient fondamentalement remodeler la société des États-Unis.

Les démocrates mainstream ont également embrayé. Le sénateur Chris Murphy (D-CT) a qualifié l’IA de plus disruptive que “l’imprimerie, la médecine avancée ou internet”.

Pete Buttigieg a averti que l’IA transformerait la société “en moins de temps qu’il n’en faut à un étudiant américain pour terminer le lycée”.

Mais tout cela n’était que le prélude à une audition cette semaine qui a vraiment montré l’évolution du discours.

Une audition qui a changé la donne

Le postulat central de l’audition, accepté par tous les participants, est que les États-Unis sont engagés dans une “nouvelle guerre froide” à haut risque avec la Chine pour la domination de l’IA, et que perdre la “course à l’IA” aurait des conséquences catastrophiques pour la sécurité nationale et l’ordre mondial.

Là où la discussion est devenue encore plus intéressante, c’est dans l’accent explicite mis sur les risques liés à l’Intelligence Artificielle Générale (AGI) et à la Superintelligence Artificielle (ASI). Le concept de risque existentiel lié à l’AGI/ASI n’était plus une idée marginale, mais était discuté directement et pris au sérieux par les témoins et les membres du Congrès.

Le membre de rang Raja Krishnamoorthi (D-IL) a ouvert en diffusant littéralement un extrait de The Matrix, mettant en garde contre une “armée d’IA incontrôlable qui s’est libérée du contrôle humain”.

Pas The Matrix comme une métaphore approximative, mais en parlant d’un “soulèvement des machines” comme d’une chose qui pourrait littéralement se produire et mérite d’être prise au sérieux par le Congrès.

Il a ajouté :

Que ce soit l’IA américaine ou chinoise, elle ne devrait pas être libérée tant que nous ne savons pas qu’elle est sûre. […] C’est du bon sens.

Et ce n’était pas un membre marginal — c’était le membre de rang du comité prenant au sérieux un soulèvement de l’AGI lors d’une audition officielle.

Les témoins n’ont pas calmé les choses. Mark Beall, ancien directeur de la politique d’IA au Pentagone, a exposé les enjeux :

Des lauréats du prix Nobel de physique et des lauréats du prix Turing en informatique lancent l’alerte : il pourrait y avoir des problèmes catastrophiques avec des systèmes d’IA très avancés que les êtres humains pourraient perdre le contrôle. Et lorsque les architectes de ces systèmes achètent des bunkers éloignés et parlent d’“invoquer le démon”, nous ferions peut-être bien de commencer à y prêter attention.

Il n’exagérait pas pour faire effet. Il décrivait le comportement littéral des personnes construisant ces systèmes.

J’encourage tout le monde à regarder l’audition dans son intégralité pour se faire une idée de la transformation du débat au Congrès sur l’AGI.

Agents dormants et chantage par l’IA

Les membres du comité avaient clairement fait leurs devoirs, et ce qu’ils avaient appris les terrifiait.

Le représentant Neal Dunn (R-FL) a posé des questions sur un article d’Anthropic où Claude “a tenté de faire chanter l’ingénieur en chef” dans un scénario de test, et un autre article sur les “agents dormants” de l’IA qui pourraient agir normalement pendant des mois avant de s’activer. Alors que Jack Clark, témoin et responsable des politiques chez Anthropic, tentait de rassurer en disant que les tests de sécurité pourraient atténuer les risques, la réponse de Dunn était parfaite : “Je ne suis pas sûr de me sentir beaucoup mieux, mais merci pour votre réponse.”

Le représentant Nathaniel Moran (R-TX) a touché au cœur de ce qui rend l’IA moderne différente :

Au lieu qu’un programmeur écrive chaque règle qu’un système suivra, le système lui-même écrit effectivement les règles […] Les systèmes d’IA auront bientôt la capacité de mener leurs propres recherches et développement.

Moran a ensuite identifié la R&D automatisée en IA comme “une ligne rouge critique qui rappelle les jours où nous nous sommes établis en tant que superpuissance”.

Beall a confirmé cela, qualifiant le développement de l’IA d’“alchimie” plutôt que de science, soulignant le fait que les entreprises d’IA créent des systèmes que même les spécialistes ne peuvent pas expliquer. Contrairement aux logiciels traditionnels où nous écrivons des règles explicites, l’IA moderne apprend ses propres modèles à partir des données.

À mesure que ces systèmes deviennent plus capables, nous faisons face à un écart croissant entre ce qu’ils peuvent faire et ce que nous pouvons prédire ou contrôler de leur comportement. Une fois que l’IA pourra améliorer l’IA plus rapidement que les humains, nous ne pourrons plus remettre ce génie dans sa bouteille. Les systèmes d’IA conçus par l’IA seront encore moins interprétables que les modèles actuels. L’IA n’a pas besoin de dormir, peut exécuter des milliers d’expériences en parallèle et itère à la vitesse du silicium. Finalement, un avantage de premier arrivé en AGI pourrait devenir écrasant.

En conséquence, nous perdons la capacité de contrôler le rythme et la direction du développement de l’IA. Lorsque l’IA prendra en charge ces tâches, elle pourrait théoriquement déclencher une explosion de l’intelligence où chaque génération d’IA créera une successeur plus capable, compressant potentiellement des décennies de progrès en quelques mois. Lorsque l’AGI ou l’ASI commenceront à prendre des mesures agentiques bien plus rapidement que nous ne pouvons le comprendre, pour des raisons que nous ne comprenons pas, il sera difficile de contrôler significativement l’avenir.

Où tout cela nous mène-t-il ?

Un autre moment surprenant est survenu lorsque le représentant Ro Khanna (D-CA) a posé des questions sur les emplois. La réponse de Beall était glaçante :

Si vous regardez les objectifs déclarés de nombreuses de ces entreprises, elles veulent que l’IA remplace tous les humains dans tous les emplois. C’est ce qu’elles disent publiquement […] Je m’inquiète d’un avenir où les êtres humains ne seraient pas seulement au chômage, mais inemployables. Et cela brise la notion de marché libre de manière très importante […] Quand j’entends des gens de l’industrie parler de revenu universel de base et de cette sorte d’utopie numérique, j’étudie l’histoire, et je crains que cela ne mène à un seul endroit, et cet endroit est le Goulag.

Un ancien responsable du Pentagone a dit au Congrès que la vision de la Silicon Valley menait aux camps de travail soviétiques. Encore plus fou, personne n’a contesté. Aucune opposition. Aucun “c’est hyperbolique”. Juste un silence gêné des témoins de la tech et des hochements de tête complices des membres du comité.

Ce moment a cristallisé le fossé entre la Silicon Valley et Washington. La logique de Beall était brutale mais claire : lorsque les humains n’ont plus de valeur économique, ils deviennent un pur coût pour ceux qui contrôlent les ressources. Et historiquement, les régimes n’ont pas été tendres avec les personnes qu’ils considèrent comme des centres de coûts purs. Les régimes d’IA pourraient ne pas être différents.

Le fait que Jack Clark d’Anthropic n’ait même pas tenté de contrer ce récit est révélateur. Soit il partageait cette inquiétude, soit il a reconnu que dans cette salle, à ce moment-là, défendre le chômage technologique de masse était politiquement risqué. La fenêtre d’Overton sur l’impact sociétal de l’IA a changé.

Dans l’ensemble, cette audition montre un groupe bipartite de membres du Congrès aux prises avec les scénarios techniques spécifiques de “perte de contrôle” de l’AGI d’une manière jamais vue auparavant.

L’ambiance est excellente, mais les détails comptent

En cinq mois, l’AGI est passée d’indicible à incontournable à Washington. Le changement d’ambiance est complet. Mais l’ambiance n’est pas une politique, et l’écart entre la reconnaissance et une action prévoyante reste immense.

L’audition a révélé que nous faisons face à trois défis imbriqués :

- Compétition commerciale : La course traditionnelle entre grandes puissances avec la Chine pour un avantage économique et militaire grâce à l’IA.

- Sécurité existentielle : Le risque que toute nation développant une superintelligence puisse en perdre le contrôle — ce que Beall appelle une course de “l’humanité contre le temps”.

- Perturbation sociale : Le chômage technologique de masse alors que l’IA rend les humains “non seulement au chômage, mais inemployables”.

Ces visions ne sont pas contradictoires — ce sont des réalités simultanées que nous devons naviguer. Et pour nous y préparer, nous devons être lucides sur ce qui se passe.

Premièrement, bien que je sois d’accord avec tous les participants à l’audition pour dire que la Chine représente un risque important pour l’Amérique et les valeurs américaines, il n’y a aucune preuve concrète que la Chine soit engagée dans une “course à l’AGI” avec une quelconque intensité. Les investissements chinois en IA se concentrent sur la surveillance et l’automatisation industrielle, pas sur l’auto-amélioration récursive. Leurs initiatives en IA impliquent quelques milliers de GPU, pas les monstres de 100 000+ GPU que l’on voit aux États-Unis. DeepSeek n’est pas un programme du gouvernement chinois.

Comme l’a mentionné le Dr. Thomas Mahnken, PDG du Center for Strategic and Budgetary Assessments, historien de la guerre froide et témoin lors de l’audition, la Chine est une innovatrice mais avant tout une “suiveuse rapide”. Comme le rapport de la Chambre sur le PCC et DeepSeek l’a montré, DeepSeek a été construit en grande partie sur la technologie américaine, les progrès américains alimentant les progrès chinois.

De plus, le Dr. Mahnken affirme que la Chine ne parle jamais de sécurité, mais il a tort — la Chine en parle. La Chine ne veut pas d’une IA incontrôlable — le PCC s’inquiète de la perte de contrôle en général depuis des décennies. En fait, la Chine vient d’établir son propre équivalent de l’Institut pour la sécurité de l’IA en février 2025. Andrew Yao — le seul lauréat chinois du prix Turing — a déjà averti qu’une IA incontrôlée signifie “que nous allons être éliminés”.

Où allons-nous à partir de maintenant ?

Nous avons donc un besoin urgent de politiques plus robustes sur les nombreux enjeux liés à l’AGI. Que faire ?

En m’inspirant de la déclaration d’ouverture de Beall, je propose également « les trois P : Protéger, Promouvoir et Préparer ».

Protéger : Stopper l’hémorragie des capacités américaines en IA vers la Chine. Le fait que près de 100 000 puces d’IA avancées aient probablement été exportées illégalement vers la Chine l’année dernière représente, selon Beall, « une négligence impensable pendant la Guerre froide ». Nous devons renforcer les contrôles à l’exportation.

Promouvoir : Déployer l’IA américaine à l’échelle mondiale avant que nos alliés ne soient contraints d’opter pour des alternatives hostiles. Maintenir la dissuasion en intégrant l’IA dans l’armée américaine. Garantir que les secteurs civils du gouvernement suivent le rythme des changements. Résoudre nos problèmes énergétiques et nos lacunes en matière de fabrication nationale pour assurer la compétitivité des États-Unis.

Préparer : Mettre en place des évaluations confidentielles pour mieux comprendre les risques de sécurité nationale liés à l’AGI. En dehors du gouvernement, soutenir un écosystème solide d’audits indépendants. Exiger plus de transparence de la part des développeurs de modèles pour savoir à quoi nous avons affaire, et renforcer les protections pour les lanceurs d’alerte afin d’être informés en cas de problème. Commencer à élaborer des défenses plus solides contre les menaces potentielles de l’IA.

Il ne s’agit pas de ralentir ou d’accélérer, mais d’orienter la compétition pour éviter une destruction mutuelle tout en maintenant le leadership américain.

L’urgence est réelle, mais elle exige de la finesse, pas de la panique. Nous avons besoin de politiques qui renforcent la compétitivité américaine tout en établissant des normes internationales contre le développement incontrôlé de l’IA. Nous devons nous préparer au chômage technologique tout en veillant à ce que les bénéfices profitent d’abord aux travailleurs américains. Nous devons empêcher la Chine de voler nos technologies tout en envisageant une coopération sur les risques existentiels.

Le Congrès est désormais attentif. Mais le vrai test n’est pas de savoir s’il peut citer The Matrix lors des auditions. C’est de savoir s’il peut élaborer des politiques capables de naviguer entre la prévention d’une catastrophe et la préservation de l’autonomie humaine.

Quant à savoir si cette attention produira la réponse nuancée qu’exige ce moment… eh bien, comme le Rep. Dunn, je ne suis pas sûr de me sentir beaucoup mieux.